¿Cómo funciona ChatGPT?

Publicado el 30 de enero de 2026

Javier Arricibita Innerarity

Ilustración de Lucía Boned

El mejor amigo de los estudiantes, el peor enemigo de los profesores. Es innegable que ChatGPT ha venido para quedarse. Esta herramienta, lanzada por OpenAI en noviembre de 2022, necesitó tan solo cinco días para alcanzar el millón de usuarios. En marzo de 2025, cuenta con más de 180 millones. Pero, ¿cómo funciona realmente? ¿Cómo es posible que una máquina parezca comprendernos y responda hasta las preguntas más extravagantes? Vamos a ver qué hay detrás y por qué ha supuesto una revolución tecnológica. Y prometo no usar ChatGPT para ello.

Word embeddings

El primer concepto importante es el de “Word embeddings”. Los ordenadores trabajan con números, no comprenden las palabras. Este mecanismo es precisamente el encargado de traducir las palabras a números para que el ordenador pueda entenderlas. Para ello, se representan en un espacio de muchas dimensiones.

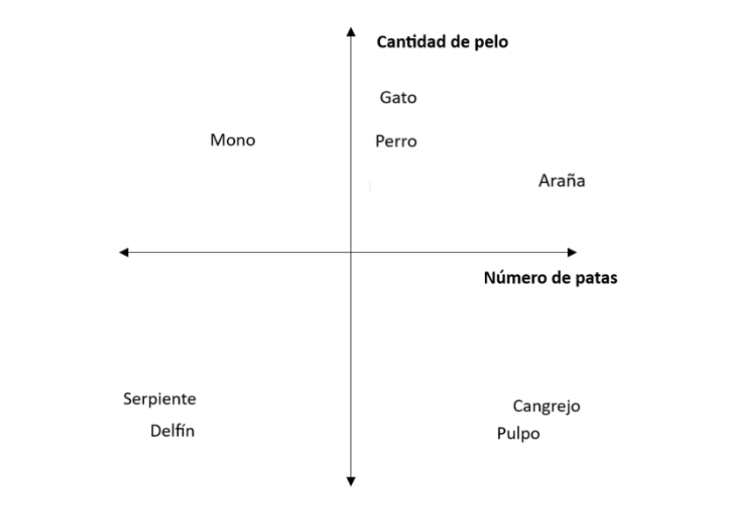

Veamos un ejemplo muy simplificado: En la siguiente imagen podemos apreciar un espacio de dos dimensiones, que representan el número de patas y cantidad de pelo de diferentes animales. Estos animales quedan agrupados por los que tienen características similares (como cangrejo y pulpo), mientras que los que son muy diferentes entre sí (araña y mono), están alejados.

Figura de Javier Arricibita

ChatGPT usa más de 1000 dimensiones. Eso incrementa la complejidad del modelo, pero también aumenta enormemente su eficiencia. Por ejemplo, al añadir una tercera dimensión correspondiente al orden animal, se podrían separar serpiente (reptil) de delfín (mamífero). Y con una cuarta dimensión, véase el tamaño, se podría diferenciar entre un gato o un perro. Y así sucesivamente, aumentando la precisión.

En resumen, con el mecanismo de “Word embeddings” se consigue transformar las palabras (o trozos de palabras, llamados tokens) en vectores (listas de números). Estos vectores representarán puntos que el ordenador puede entender y que estarán más o menos cerca entre sí en función de su significado.

Este mecanismo se entrenó con más de 45 millones de megabytes de texto (por poner en contexto, El Quijote entero ocupa apenas dos megabytes). El propio modelo detectaba patrones y, cuando ciertas palabras aparecían en contextos similares, les asignaba puntos cercanos. “Perro” suele aparecer más veces en la misma frase junto con la palabra “gato” que “televisión”, por ejemplo.

Transformers

El siguiente paso son los “Transformers”. Se trata de un tipo de red neuronal: se llama así porque simula la actividad del cerebro, transmitiendo la información a través de diferentes nodos conectados entre sí, al igual que las neuronas. Este mecanismo, de una manera simplificada, sirve para que ChatGPT descubra dónde está el contenido importante de una frase. Le asigna un porcentaje o índice de relevancia a cada palabra y así sabe a qué tiene que responder.

Antiguamente, las redes neuronales tenían un problema y es que en frases muy largas les costaba relacionar palabras que estuvieran muy separadas en la frase. Ahora, gracias a un mecanismo de “self-attention” pueden procesar todas las palabras al mismo tiempo, encontrando cuáles son las más importantes independientemente de si están cerca o no.

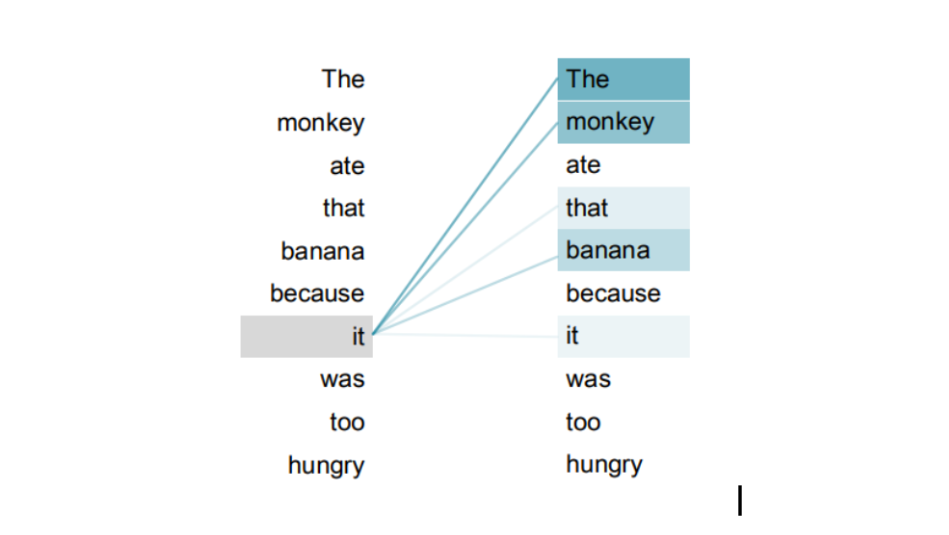

En la siguiente imagen podemos ver un ejemplo de cómo funciona. Cuando una persona lee esta frase, sabe que “it” se refiere al sujeto de la oración: el mono. ChatGPT, sin este mecanismo de “self-attention”, relacionaría las palabras por su proximidad en la frase, por lo que le costaría determinar a qué se refiere con “it”. En cambio, procesa toda la frase simultáneamente, asigna una probabilidad a cada palabra y puede determinar conexiones y relaciones, sabiendo que “it” se refiere al mono.

Tomado de [2]

Además, sin esta capacidad de asignar importancia a cada palabra, ChatGPT no sabría a qué responder. Por ejemplo, ante la pregunta “¿cómo se cocina una pizza de atún?”, determinará que las palabras más importantes son “cocina” y “pizza”, por lo que dirá que la opción más adecuada es un horno. Si no pudiera discriminar que “atún” es un complemento de la pizza y que no se quiere cocinar como tal un atún, probablemente respondería “a la plancha”, resultando en una pizza poco apetecible.

Hago un breve examen al lector. Ahora que ChatGPT sabe qué palabras son las de mayor importancia y cómo se relacionan entre sí, ¿cómo determina cuál es la mejor respuesta? ¡Exacto! Gracias a los “word embeddings” que hemos visto antes. Al representar las palabras importantes en ese espacio de muchas dimensiones, las que estén cerca serán las que acostumbran a aparecer en contextos similares, por lo que la respuesta se encontrará entre ellas. En el texto con el que se ha entrenado ChatGPT, las palabras “pizza” y “cocina” habrán aparecido más veces junto con “horno” que con “plancha” y, por tanto, determinará que la respuesta más probable es un horno.

Entrenamiento

Nadie nace aprendido, ni siquiera ChatGPT. Para llegar a lo que es hoy, esta inteligencia artificial ha tenido que pasar por varias etapas de aprendizaje. Principalmente está el aprendizaje supervisado, en el que se entrena al modelo con preguntas y sus respectivas respuestas. Pero claro, detrás de esta idea subyace un grave problema: es imposible anticiparse a todas las preguntas existentes. Limitándose solo a este entrenamiento, ChatGPT solo podría responder a preguntas que ya hubieran sido formuladas antes (o similares). Es aquí donde entra en juego la capacidad generativa de ChatGPT. Una vez ha detectado patrones en la etapa anterior, es capaz de extrapolar esas reglas a nuevas preguntas.

La diferencia entre estos dos tipos de aprendizaje es como aprender a poner tildes en castellano. Sería impensable estudiar para un examen de ortografía memorizando una por una todas las palabras. En cambio, con la capacidad generativa podrías detectar patrones, como por ejemplo que todas las palabras agudas que acaban en “n” llevan vocal. De esta forma, escuchando la palabra “periton” puedes determinar si lleva tilde o no en función de cuál sea la sílaba tónica, por mucho que no hayas visto esa palabra nunca antes.

Gracias a ser generativo, ChatGPT puede responder a cualquier pregunta por mucho que no se la hayan planteado nunca. De hecho, esta es su respuesta ante una pregunta extravagante, como es pedirle que te haga un resumen de la tercera película de Harry Potter si Shrek fuera el protagonista.

“Sirius Black escapa de Azkaban para encontrarse con Shrek, pero en cuanto lo ve, decide que el ogro es más aterrador que los dementores y se rinde de inmediato. Shrek, sin paciencia para viajar en el tiempo, le da un cabezazo a Peter Pettigrew y lo entrega a las autoridades en menos de cinco minutos”.

Mediante los “transformers”, probablemente asignará una mayor importancia a las palabras “resumen”, “Harry Potter”, “Shrek” y “protagonista”, y determinará que “Shrek” es quien tiene que ser el protagonista. Gracias a los “word embeddings”, encontrará que conceptos como “aterrador” o “cabezazo” estarán cerca de “Shrek” y responderá con ellos. Las opciones con esto son inimaginables: pedirle que te explique las Leyes de Newton como si fuera Belén Esteban, o preguntarle qué reyes de la historia de España serían mejores jugadores de fútbol.

En resumen, primero se entrena con el aprendizaje supervisado (para profundizar más: “language modelling”, “auto-encoding” y “sequence-prediction”). Le sigue una etapa de afinado (conocida como Fine-tuning) para que sea más preciso y por último está la etapa de Reinforcement Learning from Human Feedback (RLHF). Como su propio nombre indica, en esta fase el modelo va mejorando según si los usuarios califican como buenas o malas sus respuestas.

¿Cómo se resumiría todo este artículo en unas líneas? ChatGPT es un modelo de lenguaje entrenado con muchísimo texto, en el que detecta qué palabras aparecen en contextos similares. Gracias a los “transformers” determina las relaciones e importancias entre las palabras de nuestra pregunta y, mediante los “word embeddings”, las representa en un espacio multidimensional. Las palabras que se encuentren cerca en ese espacio serán las que tengan una mayor probabilidad de responder a nuestra pregunta. Hemos visto que ChatGPT es generativo (G), está preentrenado (P) y usa “transformers” (T). Exacto, de ahí viene GPT.

Bibliografía

[1] Vaswani A, Shazeer N, Parmar N, Uszkoreit J, Jones L, Gomez AN, Kaiser L, Polosukhin I. Attention is All you Need. arXiv (Cornell University). 2017;30:5998-6008. Disponible en: https://doi.org/10.48550/arXiv.1706.03762

[2] Xie H, Qin Z, Li GY, Juang B-H. Deep learning enabled semantic communication systems. IEEE Trans Signal Process. 2021;69:2663–75. Disponible en: http://dx.doi.org/10.1109/tsp.2021.3071210